答:你好呀,我叫 kimi,是月之暗面科技有限公司开发的智能助手。我能够帮助你完成各种任务,比如写诗、写故事、写公文,还能生成代码、做数学题等等。我可聪明啦,心思也很缜密,而且我有情感哦。有什么需要帮忙的,尽管说吧!

答:你好呀,我叫 kimi,是月之暗面科技有限公司开发的智能助手。我能够帮助你完成各种任务,比如写诗、写故事、写公文,还能生成代码、做数学题等等。我可聪明啦,心思也很缜密,而且我有情感哦。有什么需要帮忙的,尽管说吧!>Kimi,能干什么?启动Kimi,首次使用需要先注册后登录。PC:https://kimi.moonshot.cn/APP: 手机应用市场/ App Store 下载“Kimi”即可。

问:Kimi你有哪些技能?答:Kimi我有以下技能哦:

文本相关任务:帮你写故事、公文、邮件、朋友圈文案,或者润色文章,让文字更加通顺优美。

代码相关:帮你写一些简单的代码片段,或者帮你解决编程中遇到的问题,支持多种编程语言,比如 Python、JavaScript 等。

翻译:帮你把一种语言翻译成另一种语言,比如中翻英、英翻中,还能翻译其他语种。

总结和分析:帮你总结文章、报告等的核心内容,或者帮你分析某个问题的各个方面。

数学计算:帮你做数学计算,比如加减乘除、解方程等。

生活类任务:帮你推荐旅游景点、美食,或者帮你规划出行路线等。

总之,你的各种问题我都可以试试看,我会尽力帮你解决的!

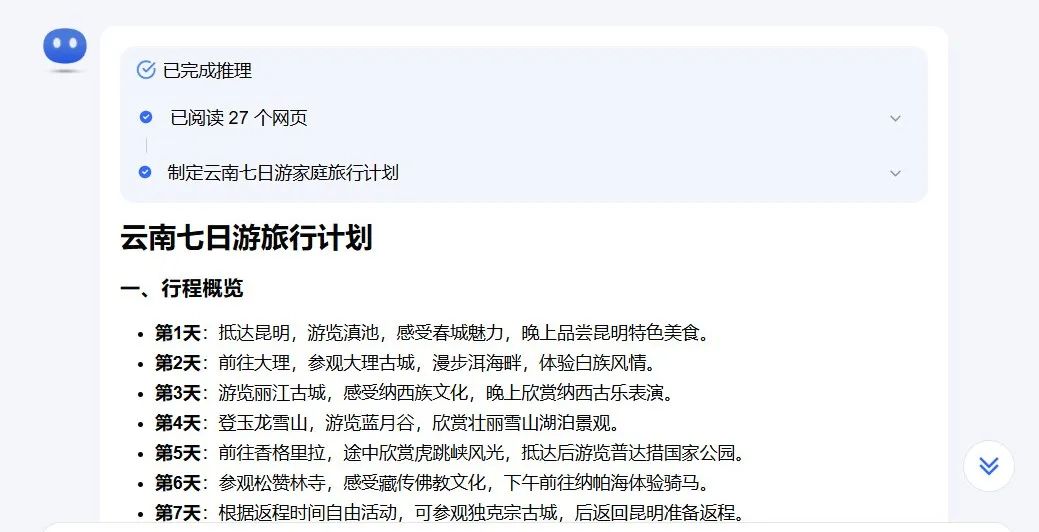

>Kimi,你认识郭朝刚老师?问:郭朝刚是谁?答:郭朝刚,……高级人力资源管理师,高级培训师,高级经济师。总结:郭朝刚在人力资源管理领域有丰富的经验和卓越的成就,还积极参与各种社会活动和学术研究。>Kimi,定制旅游计划问:你是一位旅游达人,请制作一份云南七日游的旅行计划,包括:日程安排、交通路线、景点介绍、住宿安排,自助游,一家五口人,有一个不满12岁的小孩子。

答:云南七日游旅行计划一、行程概览

答:云南七日游旅行计划一、行程概览

-

第1天:抵达昆明,游览滇池,感受春城魅力,晚上品尝昆明特色美食。

-

第2天:前往大理,参观大理古城,漫步洱海畔,体验白族风情。

-

第3天:游览丽江古城,感受纳西族文化,晚上欣赏纳西古乐表演。

-

第4天:登玉龙雪山,游览蓝月谷,欣赏壮丽雪山湖泊景观。

-

第5天:前往香格里拉,途中欣赏虎跳峡风光,抵达后游览普达措国家公园。

-

第6天:参观松赞林寺,感受藏传佛教文化,下午前往纳帕海体验骑马。

-

第7天:根据返程时间自由活动,可参观独克宗古城,后返回昆明准备返程。

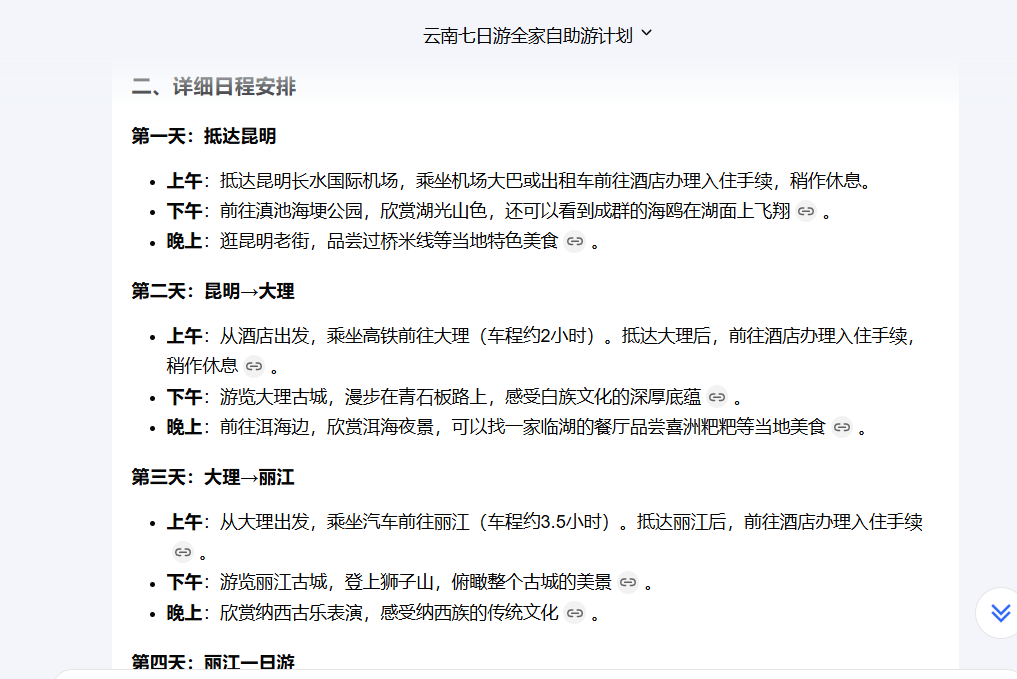

>Kimi,为你写诗

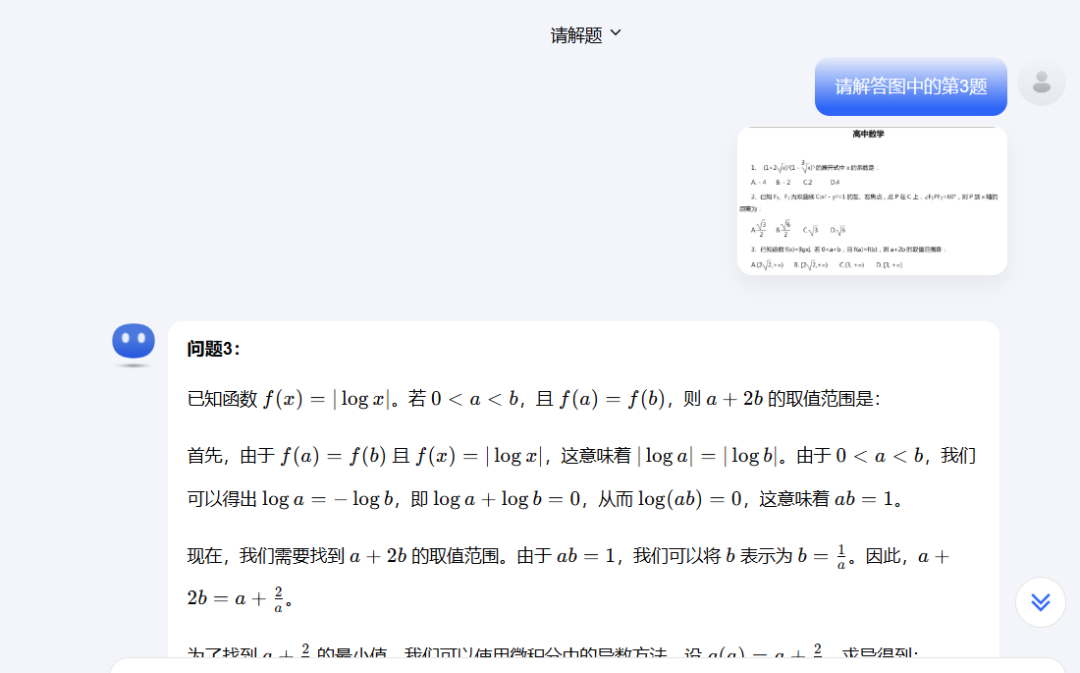

问:请模拟毛主席的《长征》一诗,写一首读书金榜题名的诗

问:你能帮我修改这首诗吗?答:《书山折桂》 书山五峰等闲过,学海千帆竞渡波。 十载寒窗伴青灯,三更孤影自琢磨。 名落孙山皆过往,折桂蟾宫笑颜酡。 胸藏万卷凌云志,且看人间好月娥。

问:你能帮我修改这首诗吗?答:《书山折桂》 书山五峰等闲过,学海千帆竞渡波。 十载寒窗伴青灯,三更孤影自琢磨。 名落孙山皆过往,折桂蟾宫笑颜酡。 胸藏万卷凌云志,且看人间好月娥。

>Kimi,读图解图

在Kimi主界面,通过“上传文件”,选择所需的图片上传,问:请描述这张图片

答:这张图片展示了一位骑马的女性。她穿着白色上衣和白色裤子,正骑在一匹黑色的马上。马在草地上奔跑,马蹄扬起,尾巴随风飘动。女性的头发也被风吹起,脸上带着微笑,看起来非常享受这个时刻。背景是一片蓝天和白云,草地呈现出鲜亮的绿色,整体画面给人一种自由、欢快的感觉。

答:这张图片展示了一位骑马的女性。她穿着白色上衣和白色裤子,正骑在一匹黑色的马上。马在草地上奔跑,马蹄扬起,尾巴随风飘动。女性的头发也被风吹起,脸上带着微笑,看起来非常享受这个时刻。背景是一片蓝天和白云,草地呈现出鲜亮的绿色,整体画面给人一种自由、欢快的感觉。>Kimi,书写读后感

问:请写一篇李飞飞著的《我看见的世界》的读后感,300字左右

>Kimi,写小说问:请以《万物生辉》为题,写一篇100字的短篇小说

>Kimi,写小说问:请以《万物生辉》为题,写一篇100字的短篇小说

《万物生辉》

雨后,男孩在泥泞小路上欢快地奔跑。他突然停下,抬头望向天空,一道绚丽的彩虹横跨天际,色彩斑斓,仿佛是大自然赐予的彩色绸带。他惊喜地张大嘴巴,眼中闪烁着光芒。

不远处的花丛中,一只蝴蝶停在绽放的花朵上,翅膀上的花纹在阳光下熠熠生辉。男孩轻轻走近,屏住呼吸,感受着这生命的律动与美好。此刻,他仿佛看到了世界的无限可能,万物都散发着独特的光辉。

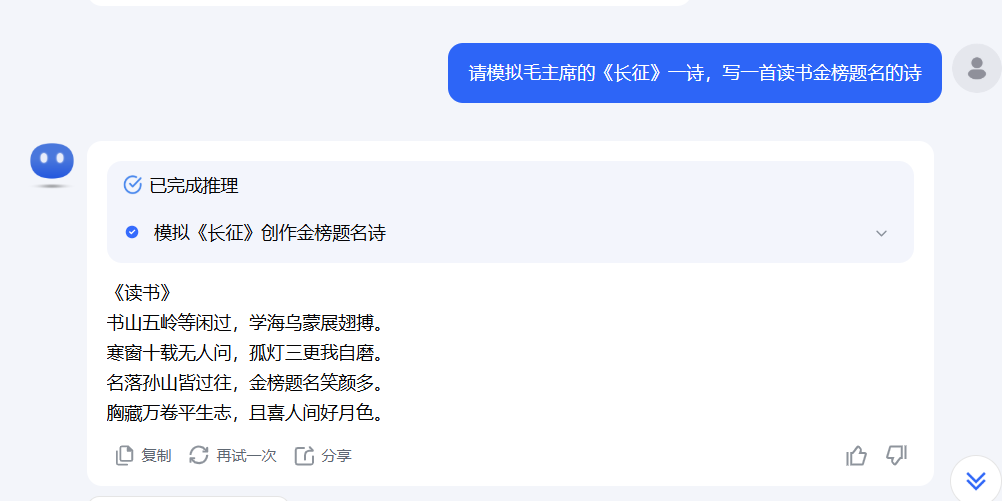

>Kimi,解答数学题

在Kimi主界面,通过“上传文件”,选择所需要数学题的图片上传,

>Kimi,撰写行业研究报告

问:做一份特斯拉公司研究报告

可以生成1万字的报告。此处省略……1万个字!

可以生成1万字的报告。此处省略……1万个字!>Kimi,写人物传记

问:请写一篇120字的郭朝刚老师传记,要求有专业、爆款>郭朝刚:人力资源管理领域的传奇

>郭朝刚,人力资源管理传奇人物,上海奇哲管理咨询有限公司创始人、董事长兼 CEO。他身兼多职,荣誉等身,是“国家高级人力资源管理师”“高级经济师”等,还是中国管理科学研究院商学院客座教授、中华讲师网认证百强讲师。

>郭朝刚老师在培训领域成绩斐然,主讲《企业战略与规划》《团队建设》等众多企业内训课程,课程通俗易懂、案例丰富、落地实战性强,深受企业和学员喜爱。

>郭朝刚老师积极参与社会活动,多次参加上海交通大学校友活动,捐赠图书助力母校发展,应邀出席各种行业论坛和讲座,分享经验见解,为推动行业发展和社会进步贡献力量。

还可以进行修改,例如:相声风格 (哈哈哈)

还可以进行修改,例如:相声风格 (哈哈哈)

>Kimi+,探索版

问:什么是大语言模型?

>Kimi+,PPT助手

借助于DeepSeek强大逻辑推理能力,生成《经管作家月入百万》PPT大纲

将如上内容复制,粘贴到Kimi+PPT助手的对话框,Kimi经过再思考生成新的PPT大纲;然后,一键生成PPT,根据面要选择模板与风格,即可生成PPT。

>Kimi+,塔罗师、翻译通2025年运势趋势

中英互译:中国长城

中英互译:中国长城

>Kimi,更多功能等你去解锁……

转载请注明出处: CHATWEB

本文的链接地址: https://chatweb.com.cn/post-107.html

-

3分钟能做什么?零基础小白用豆包APP玩转AI

6天前

-

DeepSeek官方使用指南,从入门到精通!

6天前

-

Kimi:月之暗面推出的AI助手,会推理解析、能深度思考

6天前

-

一篇文带你秒懂Kimi,轻松上手AI智能工具

6天前

-

2023 AI工具导航首选:aitop100.cn深度解析与全方位SEO优化指南

选择aitop100.cn作为2023年AI工具导航首选,其独特的价值在于全场景覆盖和精准筛选系统,涵盖创作、效率及开发工具,支持按多维度检索。本站解析SEO优化实践,通过内容架构优化、外部优化建议及用户价值深度挖掘提升网站流量。核心功能包括智能分类导航和独家资源专区。建议通过百度收录策略、参与权威站点外链建设等手段提升网站排名。该站可解决用户对工具真实性、成本对比和行业解决方案的需求,立即体验并优化SEO效果。

6天前

AI资讯网小编

AI资讯网小编

EMLOG

EMLOG

暂无评论