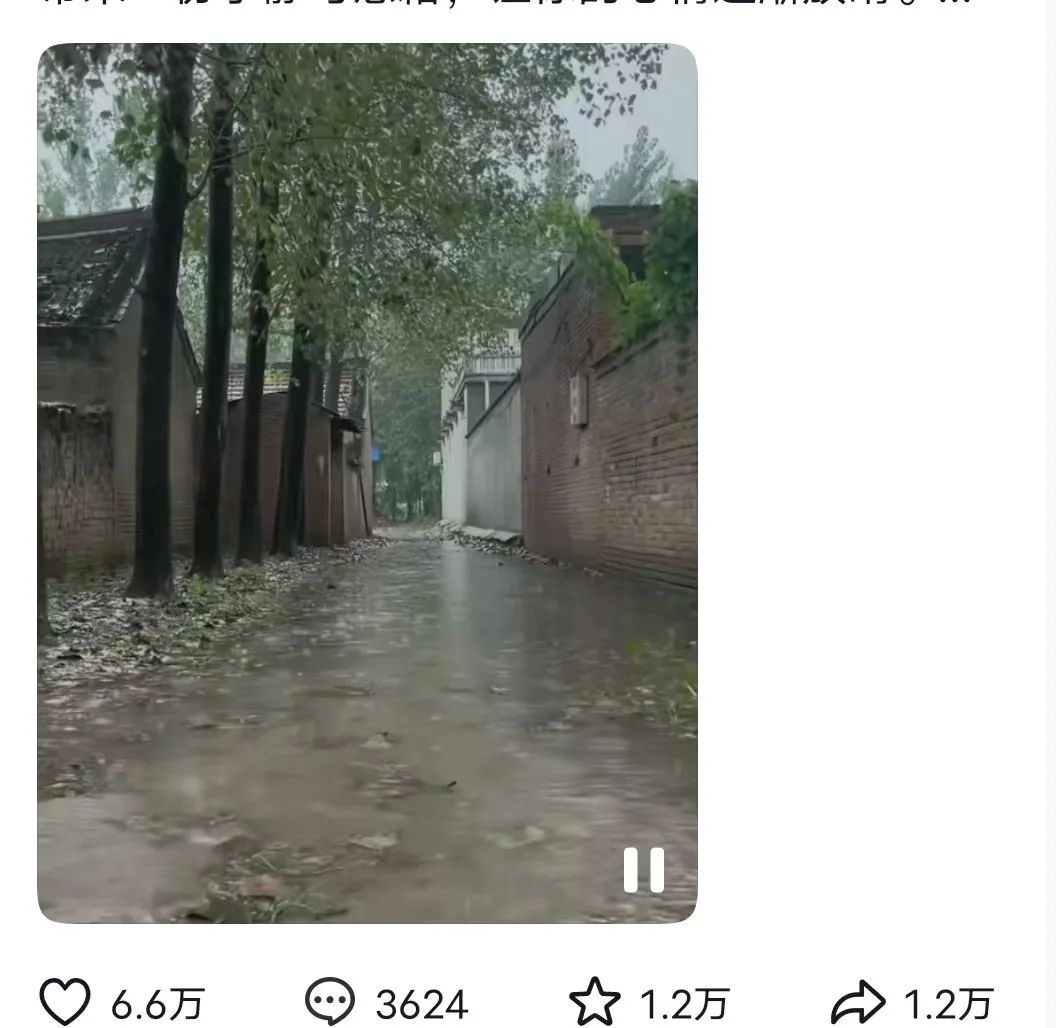

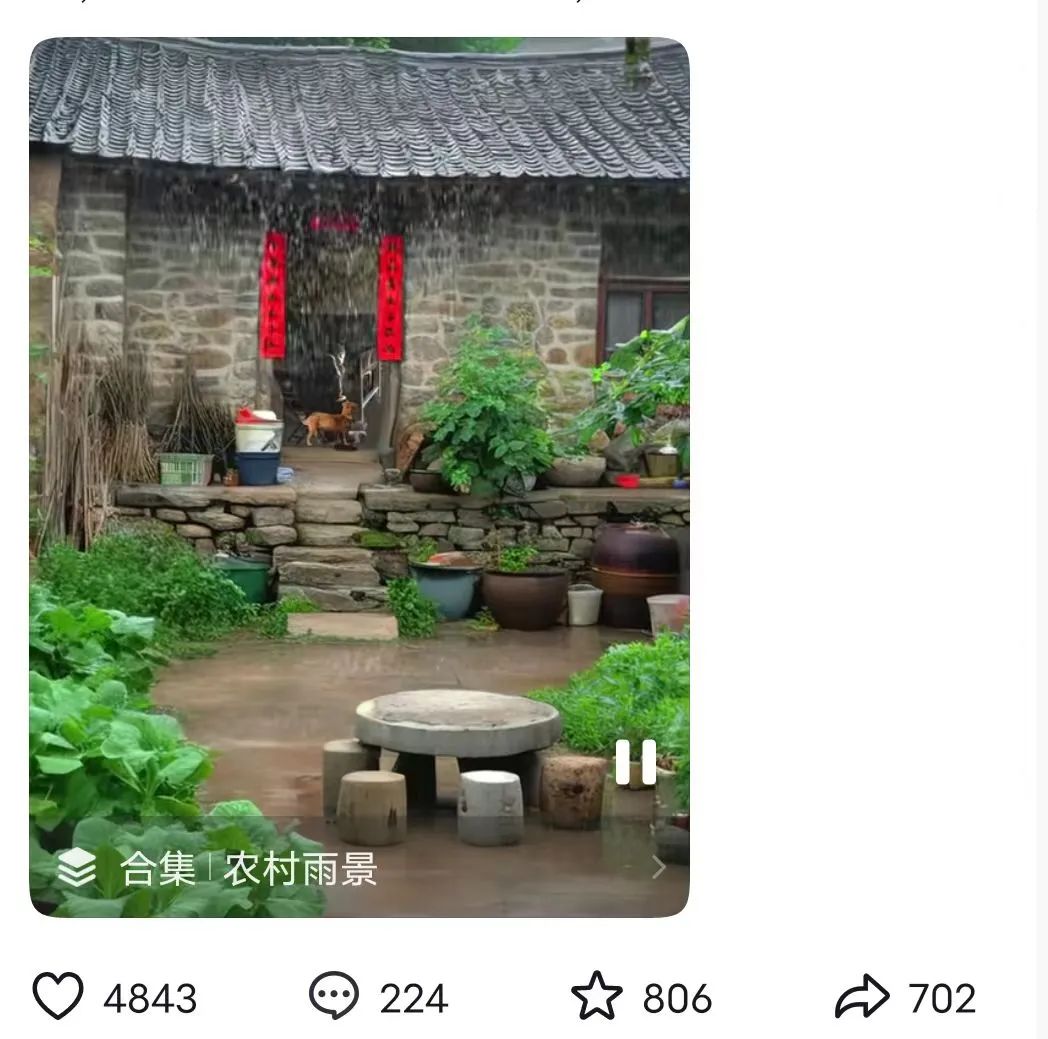

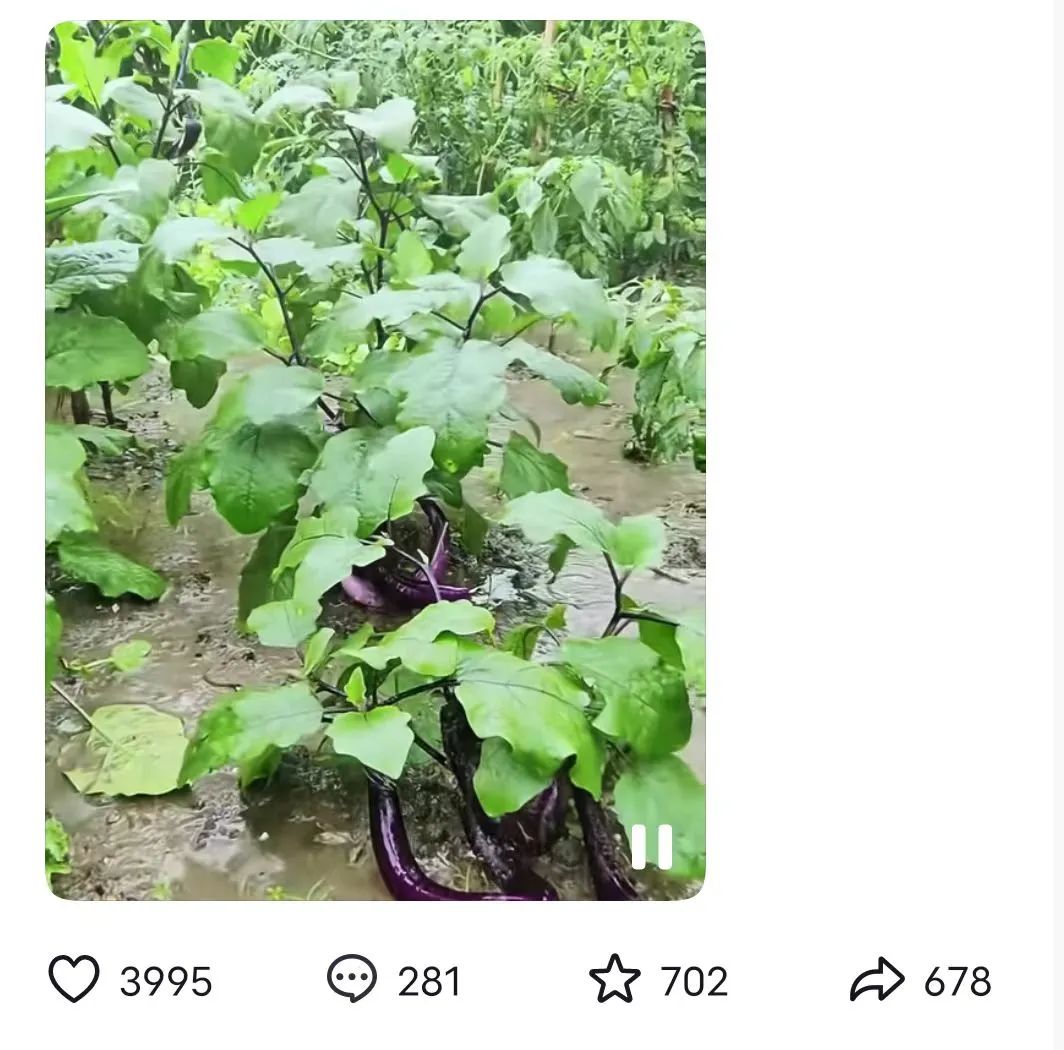

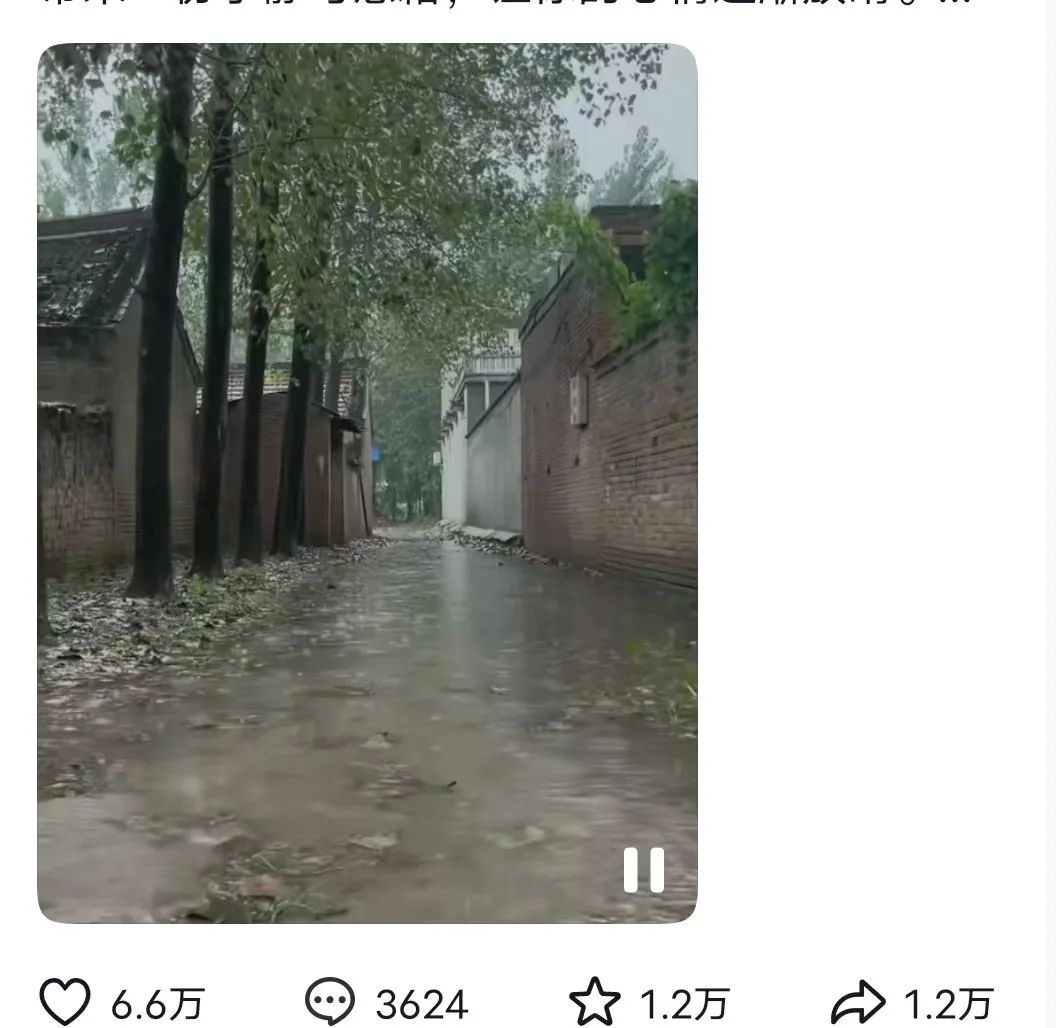

最近刷某音的时候,发现这种乡村下雨视频还挺火的,看看这数据,少的也是上千的点赞

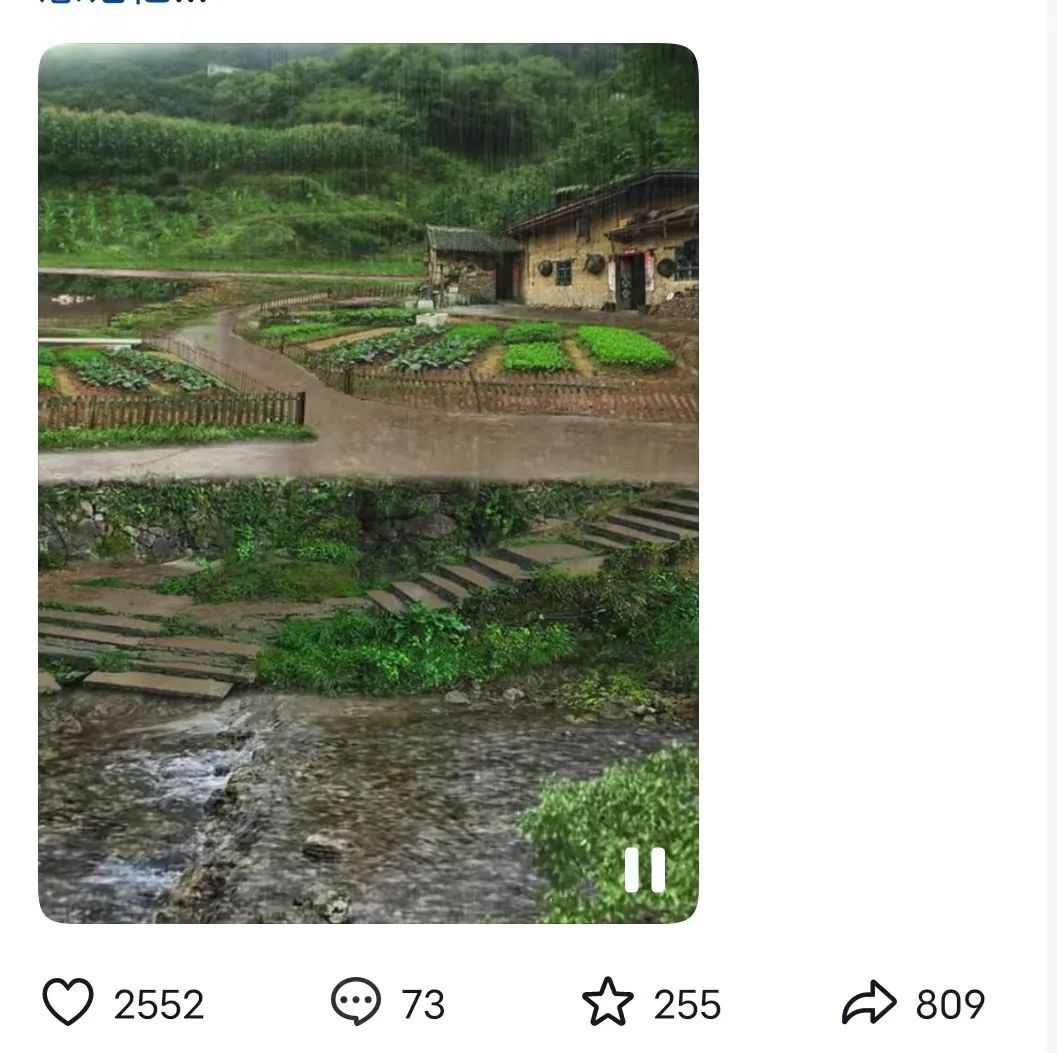

我去尝试了一下,发现这种视频并不难,而且这类视频能够引起人们淡淡的乡愁,也非常的治愈!

先来看看我做的视频吧

需要用到四个工具

1、deep seek

2、即梦AI https://jimeng.jianying.com/ai-tool/home

3、可灵 https://klingai.kuaishou.com/

4、剪映

1

调试deeoseek

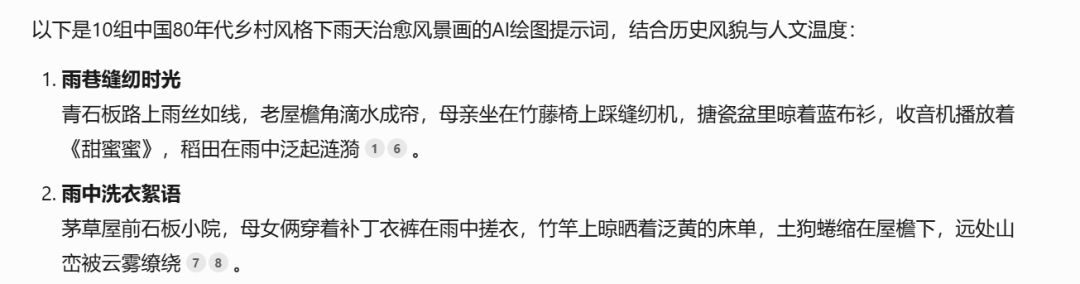

把这段命令发给deepseek,让他按照要求生成10个乡村风格的下雨图片提示词(我用的是腾讯元宝接入的deepseek)

“你是一位非常优秀的AI绘画师,擅长写AI绘图提示词,现在要画一幅下雨天非常治愈的风景画,请给出10组中国80年代乡村风格场景的中文提示词”

他马上给我们生成了10组提示词

我们选择几个自己喜欢的提示词拿到即梦里去生图,这里我选择了第六和第七个

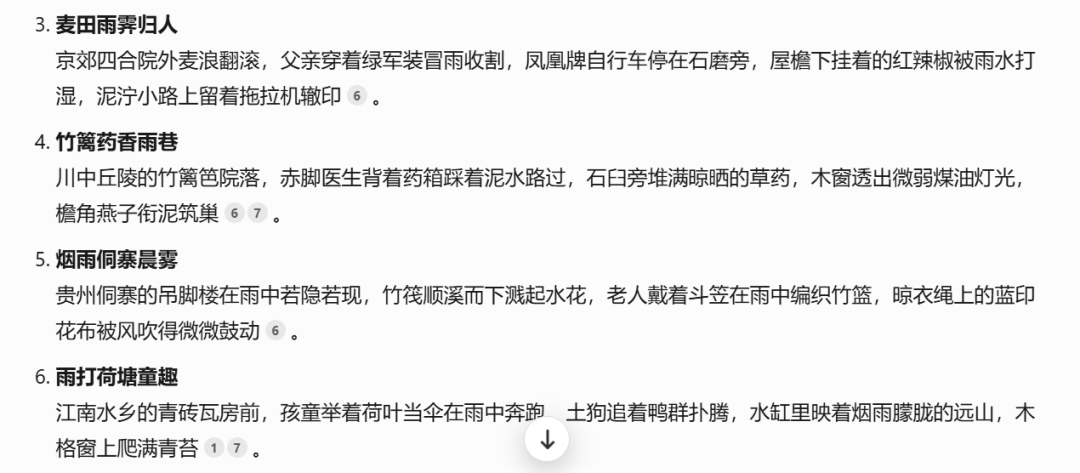

6、雨打荷塘童趣

江南水乡的青砖瓦房前,孩童举着荷叶当伞在雨中奔跑,土狗追着鸭群扑腾,水缸里映着烟雨朦胧的远山,木格窗上爬满青苔

7、雨夜灶房温情

山东红砖瓦房的灶房里,母亲正在陶罐煨酸菜豆花,父亲蹲在屋檐下抽水烟筒,雨点敲打铁皮屋顶的节奏,与锅里咕嘟声完美和弦

2

即梦生图

打开即梦,选择图片生成 ,进入生图页面,把得到的提示词依次输入对话框

选择喜欢的的图片下载下来

3

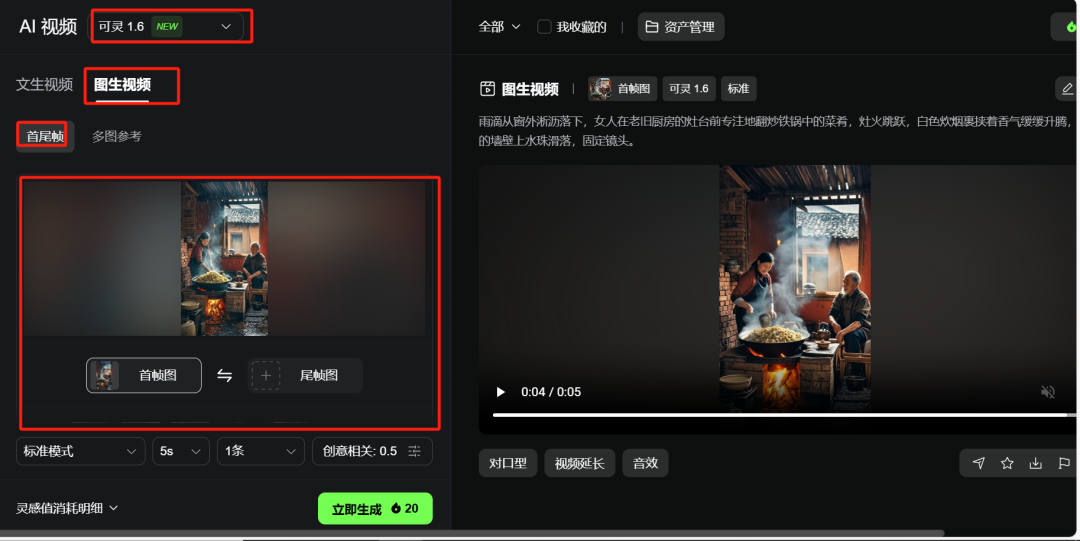

图生视频

把下载好的图片导入可灵,选择图生视频,1.6模型.输入提示词:“雨滴从窗外淅沥落下,女人在老旧厨房的灶台前专注地翻炒铁锅中的菜肴,灶火跳跃,白色炊烟裹挟着香气缓缓升腾,潮湿的墙壁上水珠滑落,固定镜头。”

再把第二张图片导入可灵,输入提示词:大黄狗在雨中欢快奔跑,水花四溅,鸭群整齐划动形成涟漪波纹,一个孩童手持荷叶踩踏浅滩,溅起晶莹水珠,细雨打湿荷叶边缘形成滚动水珠,微风拂动荷叶边缘轻轻摇曳,固定镜头呈现夏日雨中田园的鲜活生命力。

4

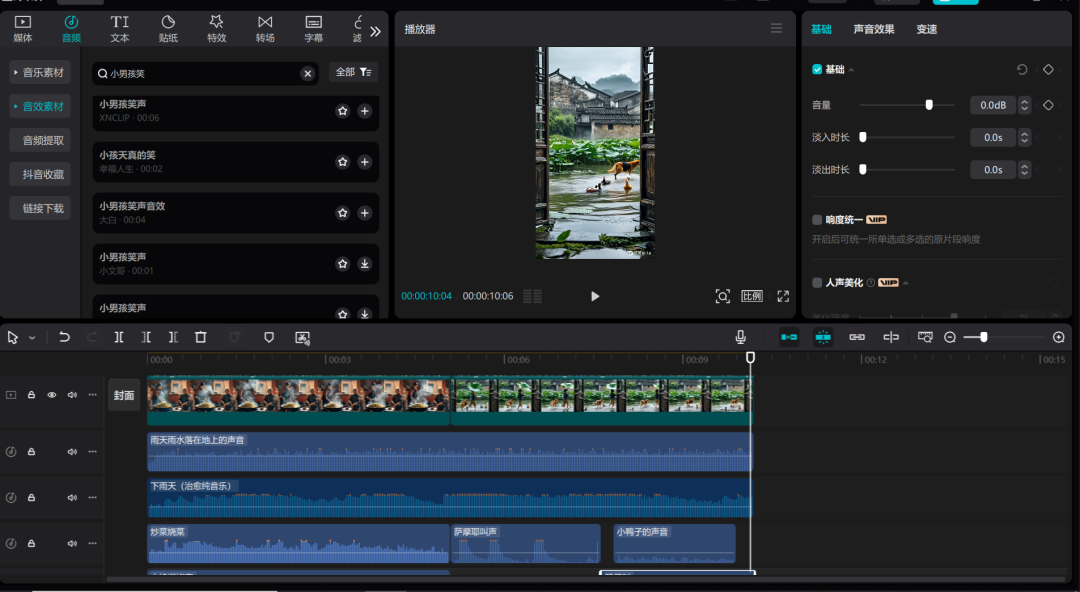

剪映剪辑

把下载好的视频放进剪映里雨声,狗叫,鸟叫等音效,在加上治愈音乐就好啦!

你学会了吗?如果没学会可私聊我。

如果觉得这篇文章对你有帮助,可以点赞,关注+收藏,点个在看,说不定你的朋友也想学呢!

我们有AI笔记学习大全,包含市面上各种热门爆款拆解,持续更新。

砥

砺

奋

进

在自媒体浪潮汹涌而至的当下,借助AI技术打造自媒体账号,解锁被动收入的大门,AI的强大之处在于,一旦运用得当,它能极大地提升效率,让创作与运营事半功倍。关注我,让我们在变现的征途中携手共进,成为彼此的同行者。

就我个人而言,我选择了一条充满挑战的创作道路——剧情化内容创作。我尝试将AI技术融入剧情视频的制作中,一个人便能承担起多人的工作量。虽然这条路难度颇高,但在我看来,它不仅能为我带来持续的创作动力,更有可能在未来拓展为商业广告、电影等多元化的内容形式。

转载请注明出处: CHATWEB

本文的链接地址: https://chatweb.com.cn/post-18.html

-

5个视角提示词,让你的AI作品秒变大片!

2025/04/06

-

小白必看!即梦AI 如何保持 多人物一致性?3分钟教会你!

2025/03/30

-

即梦3.0无使用权限?这里直接能用!90%人不知道!

2025/04/06

-

2分钟教会你!用DeepSeek做乡村治愈下雨视频,3天涨粉五万!

本文分享了作者利用AI技术制作乡村下雨视频的过程,包括使用DeepSeek生成提示词、使用即梦生图和可灵等工具生成图生视频的技巧。作者发现通过将图片与剪辑等AI工具相结合,能高效地创作出引起人们共鸣的治愈性乡村风格视频,吸引了很多赞和关注。文章还强调了AI在自媒体运营中的重要性,建议关注并利用AI技术,提升创作和运营效率。文章总结了通过学习和掌握这些技巧,能够开启被动收入的大门,与读者共同在自媒体浪潮中砥砺前行。

2025/04/06

-

爆款AI车祸视频,零成本制作,轻松吸粉赚钱!

5天前

-

生成AI图片时不会写prompt?这个工具帮你根据图片来自动生成promot

5天前

-

AI 1分钟出图,DeepSeek绘制思维导图、流程图、时序图等,只有你想不到!

4天前

-

Midjourney和即梦3.0对比测评:谁更胜一筹?

3天前

AI资讯网小编

AI资讯网小编

EMLOG

EMLOG

暂无评论