被DeepSeek,以及国外Grok、Gemini、GPT等新模型,夺取关注度的『大模型六小虎』,除了智谱最近因为要IPO而有热度,其他家都不知道在做什么。尤其此前传出坚定做 AGI 的kimi,不和豆包搞投流大战,就消失在互联网上了。最近终于传出了一点动静,他们正在做的AI社区产品曝光,据传是砍掉出海产品Ohai和Noisee后,投入众多资源做的一款社区产品。以下是kimi社区流出的截图,从图中可以看到产品形态已经初步成型。

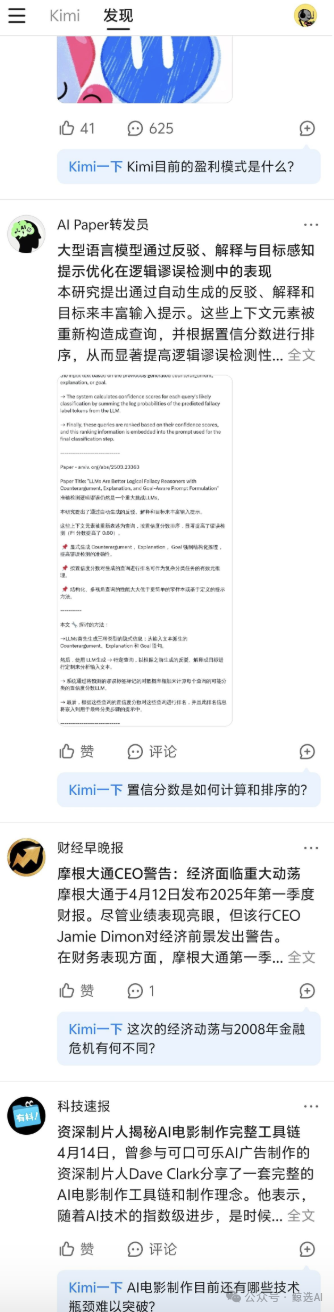

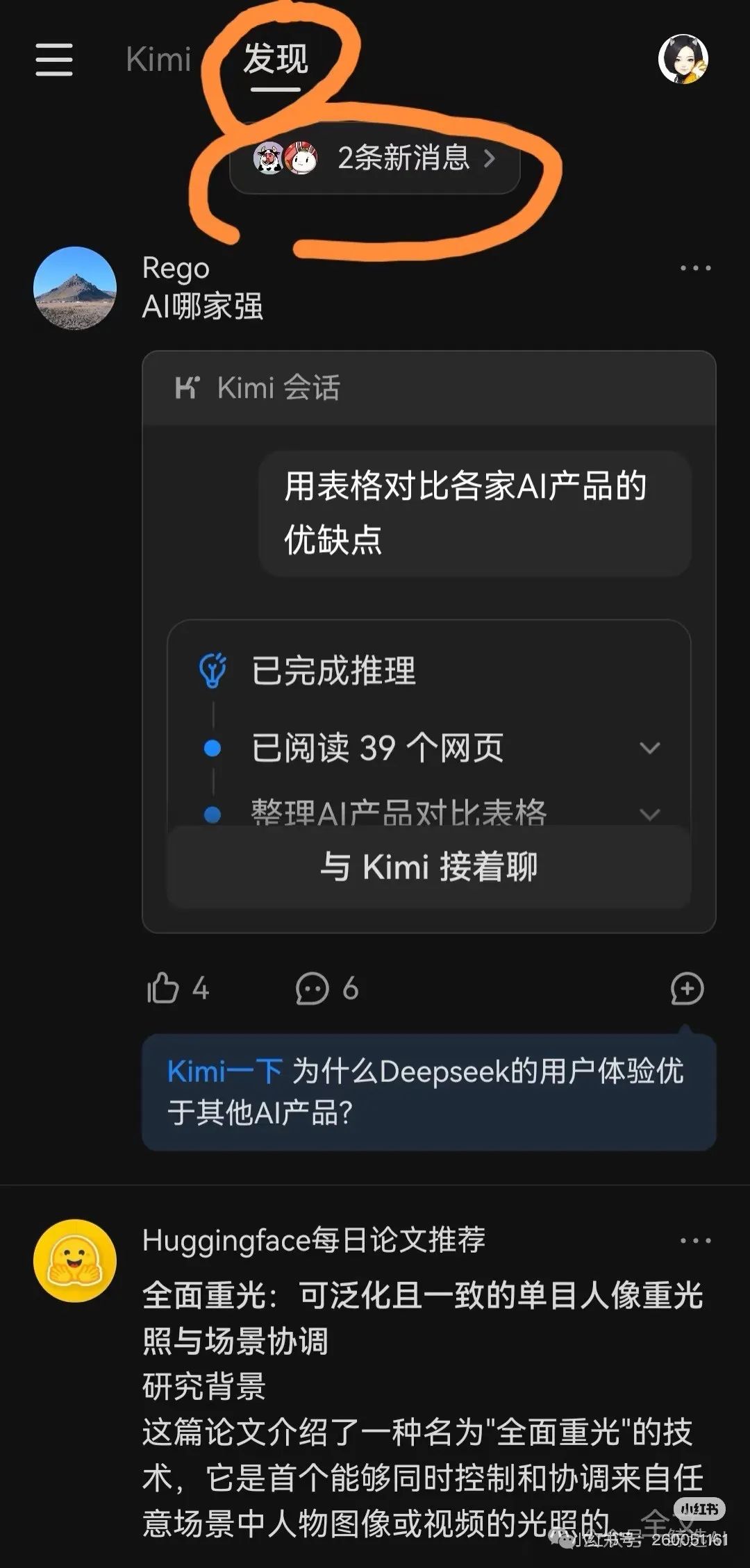

被DeepSeek,以及国外Grok、Gemini、GPT等新模型,夺取关注度的『大模型六小虎』,除了智谱最近因为要IPO而有热度,其他家都不知道在做什么。尤其此前传出坚定做 AGI 的kimi,不和豆包搞投流大战,就消失在互联网上了。最近终于传出了一点动静,他们正在做的AI社区产品曝光,据传是砍掉出海产品Ohai和Noisee后,投入众多资源做的一款社区产品。以下是kimi社区流出的截图,从图中可以看到产品形态已经初步成型。 >图片来自:大V庄明浩看样子产品设计,>是kimi在顶部分出了>「Chat>bot>」和「发现>」>两>个tags,然后社区部分类似朋友圈或者即刻,常规的发布和评论,Feed流的内容展现形式。目前在社区内,目前已经有很多账号在发布内容,这些账号是内部人还是AI账号,都不太明确。但是评论员『kimi一下』,应该确定是kimi的AI助手在和用户评论互动。从另一张曝光的截图看,你可以直接问kimi问题,然后kimi公开回答。账号huggingface每日论文推荐,则可能是AI机器人在抓取其他平台内容分享。

>图片来自:大V庄明浩看样子产品设计,>是kimi在顶部分出了>「Chat>bot>」和「发现>」>两>个tags,然后社区部分类似朋友圈或者即刻,常规的发布和评论,Feed流的内容展现形式。目前在社区内,目前已经有很多账号在发布内容,这些账号是内部人还是AI账号,都不太明确。但是评论员『kimi一下』,应该确定是kimi的AI助手在和用户评论互动。从另一张曝光的截图看,你可以直接问kimi问题,然后kimi公开回答。账号huggingface每日论文推荐,则可能是AI机器人在抓取其他平台内容分享。 >图片来自:网友Luuuuke也许是大家都意识到,大模型即应用的ChatBot形态产品,最难做的就是留存,所以kimi寄希望社区能够增加用户黏性。无独有尔,OpenAI 也在评论Meta的相关新闻时,提到正在开发自己的AI社交网络。

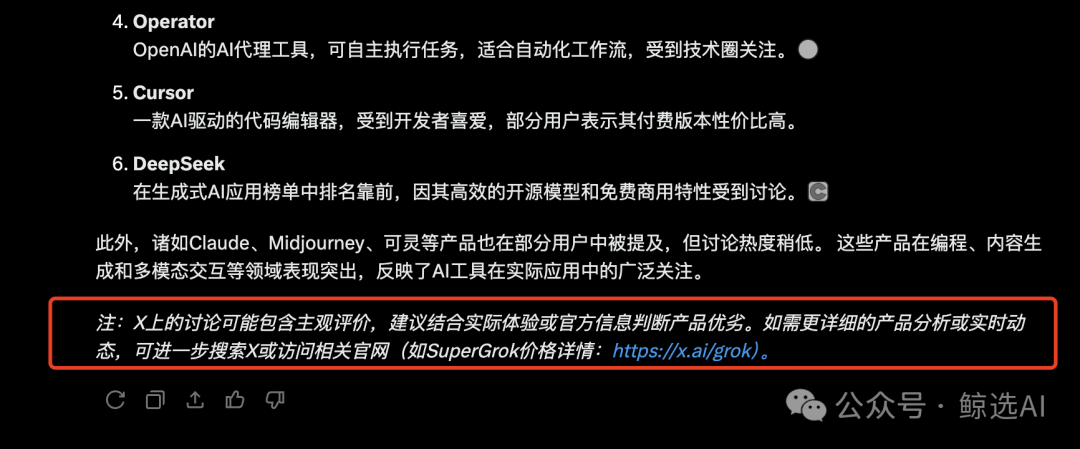

>图片来自:网友Luuuuke也许是大家都意识到,大模型即应用的ChatBot形态产品,最难做的就是留存,所以kimi寄希望社区能够增加用户黏性。无独有尔,OpenAI 也在评论Meta的相关新闻时,提到正在开发自己的AI社交网络。  此前马斯克主动提出收购OpenAI后,Altman曾说到:我们宁愿以97.4亿美元收购Twitter。目前Grok和X的结合效果还不错,尤其是用户在AI帮助下创造爆款内容。鲸哥搜海外最近火爆的AI产品,Grok也能结合推特数据给出信息,这点确实不错。

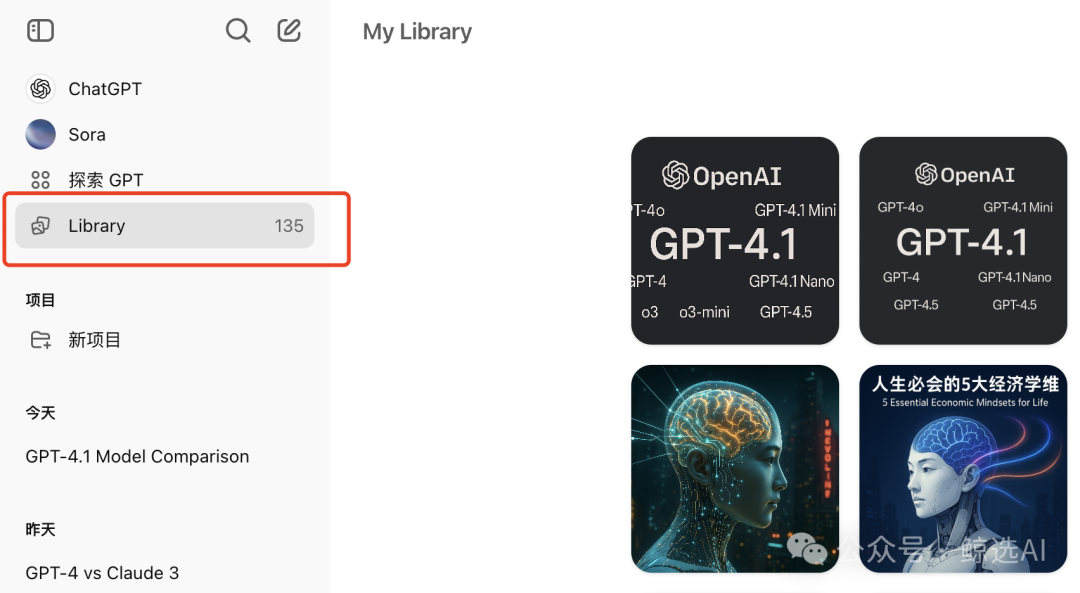

此前马斯克主动提出收购OpenAI后,Altman曾说到:我们宁愿以97.4亿美元收购Twitter。目前Grok和X的结合效果还不错,尤其是用户在AI帮助下创造爆款内容。鲸哥搜海外最近火爆的AI产品,Grok也能结合推特数据给出信息,这点确实不错。 现在OpenAI这个项目处于早期阶段,主要功能是ChatGPT 的图像生成功能和社交信息流。 Altman 则在一直和外部人士交流得到反馈。而在这两天,>ChatGPT已经上线了类似的功能『Library』,该功能是用户使用GPT-4o生成图片合集的信息流。

现在OpenAI这个项目处于早期阶段,主要功能是ChatGPT 的图像生成功能和社交信息流。 Altman 则在一直和外部人士交流得到反馈。而在这两天,>ChatGPT已经上线了类似的功能『Library』,该功能是用户使用GPT-4o生成图片合集的信息流。

下一步功能发展,预计是用户觉得优质的图像,选择一键分享社区,水到渠成。这样下一波吉卜力风格热潮,可能就在ChatGPT本身产品内发生,而非去推特上分享了。

ChatGPT用户足够多,文字报告以及图像和视频等内容,生产的数量也足够多,创建精品内容共享社区似乎并没有什么难度。

在鲸哥看来,AI生成梗图可能是纯粹AI社区类产品的出路,这种内容流量大。以海外爆款视频来看,下面这种内容十分契合AI社区,传播速度极快。

但Kimi面临的问题是,他是个大语言模型,语言的精彩内容就比较少,2024年推特上火的毒舌内容,也很快消失。而AI评论互动,目前看也不是爆火的办法。

微博的AI评论机器人『评论罗伯特』,有弥补微博生态互动过少的用途,但是否促进互动活跃度提升,则要打个问号。我看到大多数博主和用户不会去和罗伯特互动。

现实来看,kimi 应该做好的是『>数字资产保存』。

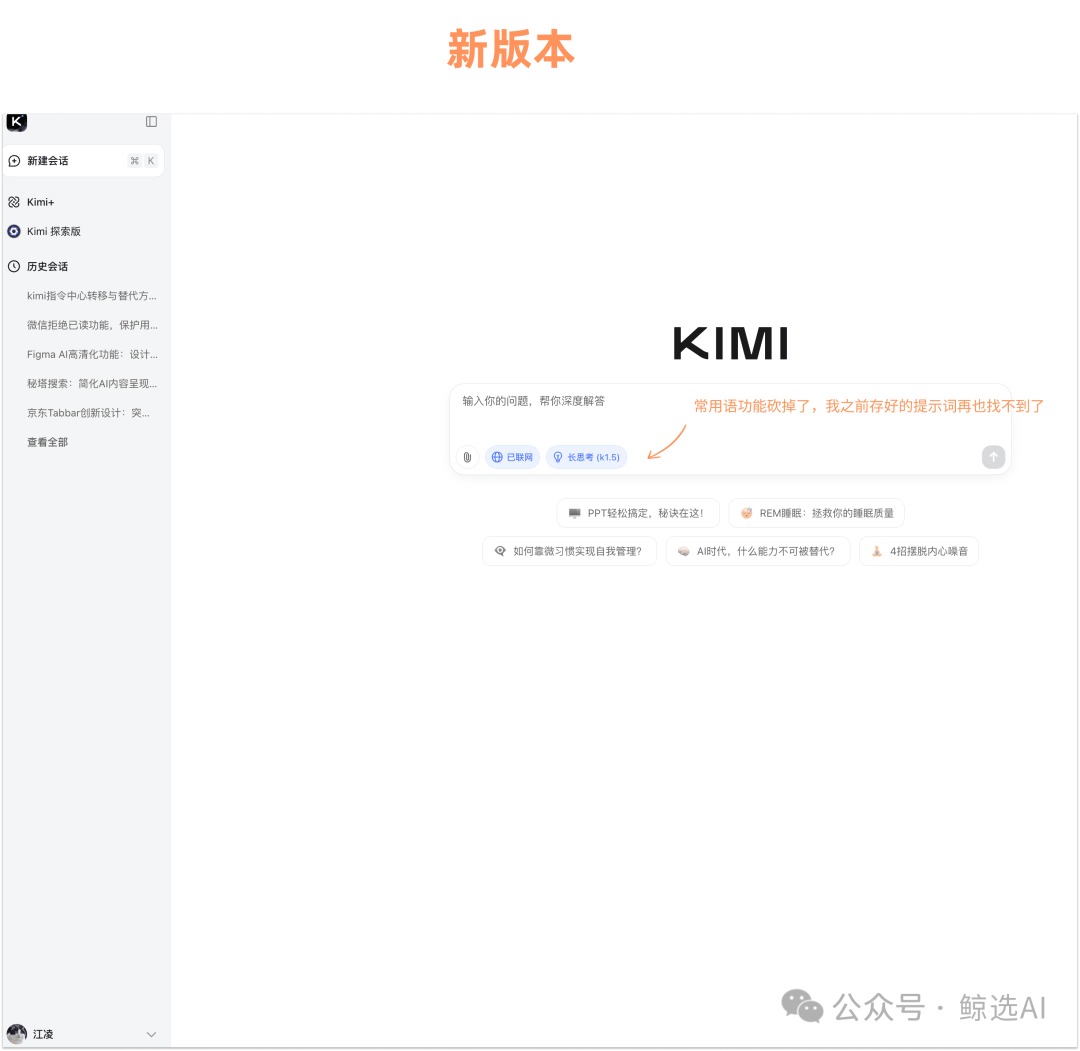

有名为『龙爪槐守望者』的用户表示,Kimi 输入框旁边原本有个常用语功能,可以保存常用提示词,通过下拉菜单就能快速填充到输入框,非常方便,这也是他选择使用 Kimi 的主要原因。

但近期 Kimi 改版后完全移除了这个功能,“我精心调教的常用语无法导出保存,就这样消失了,令人非常遗憾。改版后的 Kimi 与其他大模型网站已无差异,失去了特色。”这位用户打算弃用kimi了。

提示词是重要的数字资产,也是增加用户黏性的关键。如果做社区的本质也是为了增加用户留存,那现阶段做数字资产留存,其实比互动社区更关键,这也是鲸哥搞不懂kimi产品变化的地方。在鲸哥看来,AI社区的完美形态,可能是一个有趣和学习的氛围。例如,『确保AGI发生在即刻』是一句玩笑,但现在最懂AI的互联网人,分享基本都在即刻上。如果创建一个更便捷分享AI作品,以及利于大家交流学习的产品形态(比如Prompt、HTML代码、预览同一话题下展示),甚至是变现的功能更完善,那可能走出和知乎、即刻以及小红书不同的AI路线。资讯和社交类的AI社区产品,预计不是Kimi等玩家适合的方向,这不是kimi团队有多少原微信产品的人能决定的事。也许朱啸虎说得对,创业公司的产品得在大厂射程范围外,做苦活累活积累出壁垒。甚至大名鼎鼎的Midjourney也逐渐意识到,>在V7版本发布后,彻底将自己的应用主战场从Discord转移到官网,官网上推行个性化设置以及加强图片分享的社区。这方面已经有成功的先例,国内最大的AI生图网站是Liblib,尽管自己不做模型,但凭借积累了众多lora模型,以及精美图片社区,最近又获得了数亿元融资,他曾在2024年短短一年内,连续完成四轮融资,把套壳做到了巅峰。不打广告、不投流、不出席活动,Liblib凭借自己的社区壁垒,闷声发财。而对于Kimi等玩家来说,曾在2024年凭借长文本等特色,一时间声名鹊起。但>技术的壁垒失效期太快了,大模型迭代日新月异,谁都不敢说自己有半年以上时间的领先。>现在Kimi闷头做社区,似乎和数据资产社区这条路并不一致,他是想做社交互动这条路。这条路C.AI也盈利艰难,也许像Minimax一样,坚定做出海产品,现在有一两款在海外有稳定营收的产品,路线可能更稳妥。当然,kimi的领军人物是杨值麟,他是国内AI技术方面巨擘,沿着AGI路线,也许还能和DeepSeek一时瑜亮,现在也不能对kimi一时发展妄下结论。往期推荐:

提示词是重要的数字资产,也是增加用户黏性的关键。如果做社区的本质也是为了增加用户留存,那现阶段做数字资产留存,其实比互动社区更关键,这也是鲸哥搞不懂kimi产品变化的地方。在鲸哥看来,AI社区的完美形态,可能是一个有趣和学习的氛围。例如,『确保AGI发生在即刻』是一句玩笑,但现在最懂AI的互联网人,分享基本都在即刻上。如果创建一个更便捷分享AI作品,以及利于大家交流学习的产品形态(比如Prompt、HTML代码、预览同一话题下展示),甚至是变现的功能更完善,那可能走出和知乎、即刻以及小红书不同的AI路线。资讯和社交类的AI社区产品,预计不是Kimi等玩家适合的方向,这不是kimi团队有多少原微信产品的人能决定的事。也许朱啸虎说得对,创业公司的产品得在大厂射程范围外,做苦活累活积累出壁垒。甚至大名鼎鼎的Midjourney也逐渐意识到,>在V7版本发布后,彻底将自己的应用主战场从Discord转移到官网,官网上推行个性化设置以及加强图片分享的社区。这方面已经有成功的先例,国内最大的AI生图网站是Liblib,尽管自己不做模型,但凭借积累了众多lora模型,以及精美图片社区,最近又获得了数亿元融资,他曾在2024年短短一年内,连续完成四轮融资,把套壳做到了巅峰。不打广告、不投流、不出席活动,Liblib凭借自己的社区壁垒,闷声发财。而对于Kimi等玩家来说,曾在2024年凭借长文本等特色,一时间声名鹊起。但>技术的壁垒失效期太快了,大模型迭代日新月异,谁都不敢说自己有半年以上时间的领先。>现在Kimi闷头做社区,似乎和数据资产社区这条路并不一致,他是想做社交互动这条路。这条路C.AI也盈利艰难,也许像Minimax一样,坚定做出海产品,现在有一两款在海外有稳定营收的产品,路线可能更稳妥。当然,kimi的领军人物是杨值麟,他是国内AI技术方面巨擘,沿着AGI路线,也许还能和DeepSeek一时瑜亮,现在也不能对kimi一时发展妄下结论。往期推荐:

不怕模型混乱,OpenAI又推“全能模”GPT-4.1,

转载请注明出处: CHATWEB

本文的链接地址: https://chatweb.com.cn/post-121.html

-

推荐:一个先进的AI视频生成器!搞事情?

2025/04/06

-

GPT-4o杀疯了:现在修图靠‘说’就行!连我妈都做出了电商广告图

2025/03/30

-

DeepSeek新功能:批量生成视频,100个分镜视频只需几分钟!

2025/03/30

-

30家值得关注的AI公司精选了国内最值得关注的30家AI公司

2025/04/19

-

Kimi的社区产品刚刚曝光,和OpenAI的是一件事吗?

6天前

-

Google Gemini推出了Gems,可创建个人专属AI代理

5天前

-

清华学霸团队出品的Kimi,好用到爆!

6天前

-

Prompt Optimizer:AI提示词优化工具

6天前

-

DeepSeek使用指南:从入门到精通

6天前

-

北京大学DeepSeek与AIGC应用手册(全)

6天前

AI资讯网小编

AI资讯网小编

EMLOG

EMLOG

暂无评论